1. 使用一鍵安裝器安裝主程式#

開發者在oobabooga/text-generation-webui Wiki - GitHub提供Linux/Windows/macOS的一鍵安裝器,會自動裝好Python與依賴套件,但是語言模型您得另外下載。

如果您是Linux系統,需要先安裝Nvidia專有驅動以及CUDA

點選Github Releases取得一鍵安裝器

main.zip,您可以放置到任意硬碟位置。將

main.zip解壓縮,進入text-generation-webui-main資料夾按照您的作業系統執行指令稿。日後要啟動Text Generation WebUI也是使用此指令稿。

Linux → 於該資料夾開啟終端機,輸入./start_linux.sh

Windows → 於該資料夾對start_windows.bat兩下執行。

macOS → 開啟終端機,切換到text-generation-webui-main所在位置,例如cd ~/下載/text-generation-webui-main,接著執行./start_macos.sh

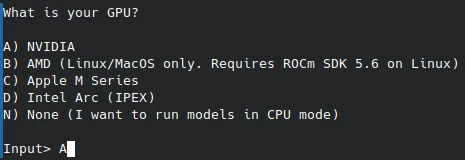

中間會詢問顯示卡晶片,這裡我輸入A選擇Nvidia。

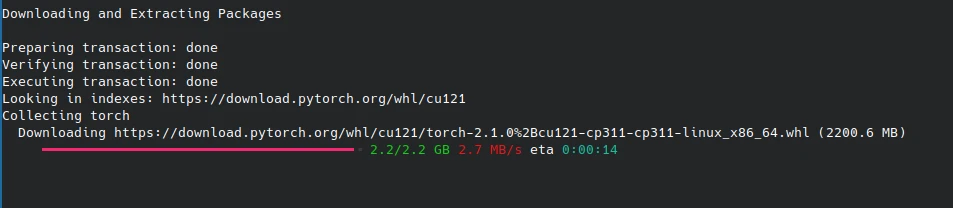

等待依賴套件下載完成,大約10GB

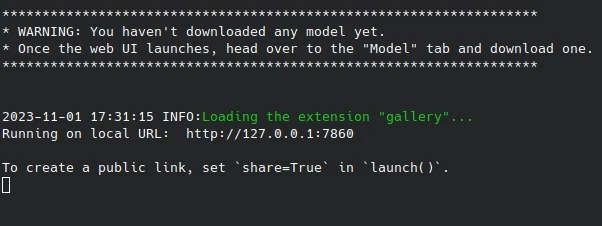

裝完依賴套件後會顯示此訊息

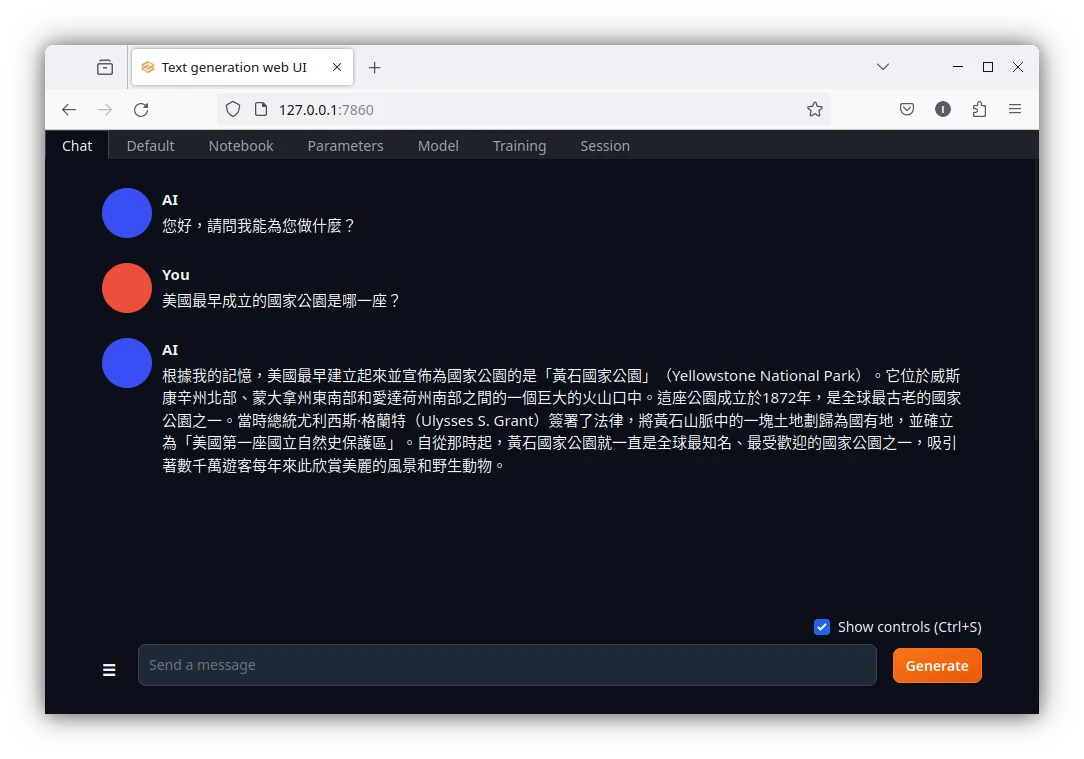

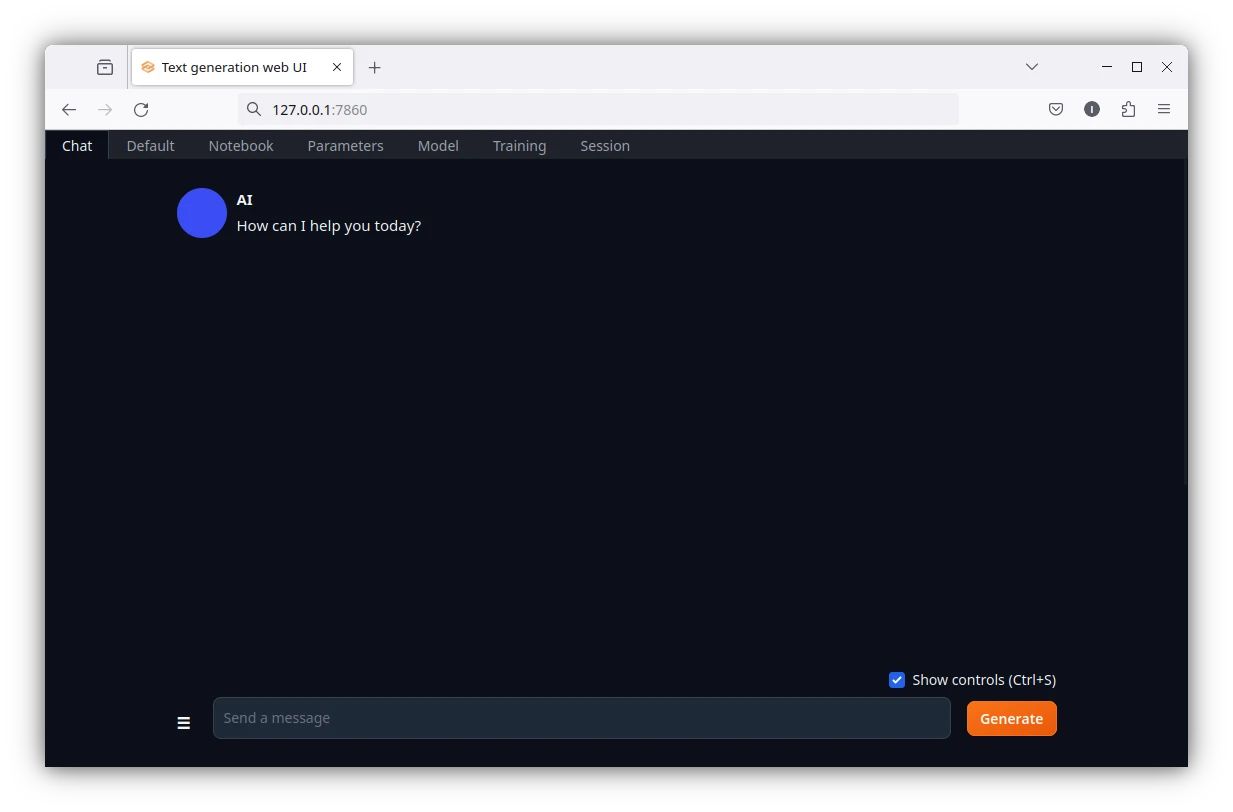

用瀏覽器開啟

http://127.0.0.1:7860,進入網頁界面。確認網頁界面可以跑出來後,開始下載模型。

2. 如何更新主程式#

執行對應的指令稿,程式就會自己下載更新:

Linux → update_linux.sh

Windows → update_windows.bat

macOS → update_macos.sh

如果更新後Python依賴套件出錯,請嘗試刪除installer_files/env資料夾,再啟動WebUI,讓它重裝依賴套件。